Les outils internes sont essentiels pour rationaliser les flux de travail, gérer les données et réduire les erreurs. Mais à mesure que les entreprises se développent, ces outils font souvent face à des défis d'évolutivité - performances plus lentes, corrections manuelles ou même défaillances du système. La solution ? Construire pour l'évolutivité dès le départ. Voici ce que vous devez savoir :

Des plateformes comme Adalo, un générateur d'applications sans code pour les applications web basées sur des bases de données et les applications iOS et Android natives - une seule version sur les trois plates-formes, publiées sur l'Apple App Store et Google Play, aident les équipes à résoudre ces préoccupations d'évolutivité dès le départ. En fournissant des outils de développement visuels et des fonctionnalités prêtes pour l'entreprise, ces plates-formes permettent aux entreprises de créer des outils internes qui peuvent croître parallèlement à leurs opérations.

- Planifier à l'avance: Définissez les besoins en matière de performance tels que la charge utilisateur et le trafic de pointe avant le début du développement.

- Conception modulaire: Divisez les outils en composants indépendants pour simplifier les mises à jour et gérer la croissance.

- Optimiser les performances: Utilisez le traitement côté serveur, la mise en cache et la mise à l'échelle automatique pour maintenir la vitesse.

- Sécurité d'abord: Implémentez le contrôle d'accès basé sur les rôles (RBAC) et l'authentification unique (SSO) pour un accès rationalisé et sécurisé.

- Intégrer intelligemment: Connectez-vous efficacement aux bases de données et aux systèmes existants, en évitant les silos de données.

Des plateformes comme Adalo simplifie ce processus avec la création d'applications pilotée par l'IA, les versions unifiées pour le web et mobile, et les fonctionnalités de qualité entreprise comme SSO et RBAC. Que vous créiez des tableaux de bord ou des flux d'approbation, commencer avec une architecture évolutive garantit que vos outils croissent avec votre entreprise - sans refonte coûteuse.

Planifier l'évolutivité dès le départ

Développement personnalisé par rapport aux plates-formes de générateurs d'applications - Comparaison des outils internes

Les problèmes d'évolutivité vous surprennent souvent. Ils n'apparaissent généralement pas pendant le développement, mais surgissent lorsque votre outil interne est mis à l'épreuve - comme lorsque le nombre d'utilisateurs augmente, que les données triplent, ou qu'un autre département commence à dépendre du système. Au moment où ces problèmes surviennent, les corriger peut signifier réécrire de grandes portions de code, migrer des bases de données ou même revenir à des processus manuels.

Le meilleur moyen d'éviter ces tracas ? Commencez à planifier l'évolutivité avant d'écrire une seule ligne de code. Au départ, définissez à la fois les exigences fonctionnelles et exigences non fonctionnelles. Cela signifie non seulement déterminer ce que l'outil doit faire, mais comment il doit performer sous pression. Par exemple, considérez les charges d'utilisateurs attendues, les taux de requêtes de pointe et même les modèles de trafic saisonnier. Si votre outil est conçu pour l'intégration, pensez à l'avance : que se passe-t-il si votre entreprise double sa main-d'œuvre en six mois ? Planifier la croissance dès le départ garantit que vos outils peuvent supporter la pression à mesure que l'organisation se développe.

Une autre stratégie clé consiste à concevoir des unités d'échelle indépendantes. Si votre outil gère plusieurs fonctions, comme l'inventaire et le support client, assurez-vous qu'une augmentation dans un domaine ne ralentit pas les autres. Mappez ces unités aux flux de travail critiques pour vous assurer que tout problème reste contenu et ne se propage pas dans tout le système.

Les seuils de performance sont un incontournable. Par exemple, les requêtes qui prennent plus de 5 secondes frustrent les utilisateurs, et essayer d'afficher plus de 1 000 lignes dans un tableau côté client peut causer des problèmes de performance. Abordez ces limites pendant la phase de conception pour éviter les plaintes ultérieures. Comme Microsoft le souligne judicieusement :

« Dans la mesure du possible, utilisez des solutions éprouvées par l'industrie au lieu de développer les vôtres. »

Il est également important de rester au courant de la dette technique. Bien qu'une certaine dette soit inévitable, vous pouvez la gérer en programmant des tâches régulières pour résoudre les mises à jour de la plateforme avant qu'elles ne deviennent des urgences. Établissez la gouvernance dès le départ, standardisez votre contrôle de version et vos processus de déploiement, et priorisez la testabilité. De cette façon, vos outils se développent avec votre entreprise au lieu de devenir un goulot d'étranglement qui pourrait vous coûter jusqu'à 28 % des revenus potentiels.

Cartographier les flux de travail et les exigences des utilisateurs

Commencez par parler aux personnes qui utiliseront réellement l'outil. Menez des entretiens dans les équipes pour comprendre leurs tâches quotidiennes, les défis auxquels elles sont confrontées et ce dont elles ont vraiment besoin du système. Ne prenez pas les demandes au pied de la lettre - observez comment ils travaillent. Par exemple, une équipe de vente peut demander un tableau de bord riche en données, mais elle n'utilise peut-être que quelques métriques clés qui doivent se charger rapidement.

Déterminez si les utilisateurs ont besoin d'une fonctionnalité complète CRUD (Créer, Lire, Mettre à jour, Supprimer) ou juste d'une analyse visuelle. Les tâches lourdes en CRUD, comme la gestion des factures, nécessitent des formulaires et des interfaces de table. En revanche, les équipes à la recherche d'informations - comme les cadres examinant les performances trimestrielles - bénéficient davantage de visualisations claires et rapides à charger.

La planification de la capacité joue également un rôle important. Ne devinez pas combien d'utilisateurs votre outil supportera ; calculez-le. Si vous avez actuellement 200 employés mais prévoyez d'en ajouter 500 l'année prochaine, concevez pour 700 utilisateurs simultanés - pas seulement pour les chiffres d'aujourd'hui. Considérez également la distribution géographique. Bien que les zones de disponibilité maintiennent généralement la latence en dessous de 2 millisecondes, les équipes mondiales peuvent avoir besoin d'une approche différente pour assurer une synchronisation des données fluide.

Les flux de travail évoluent aussi. Un simple processus d'approbation des dépenses à deux personnes dans une startup peut se transformer en un flux de travail multi-départements. Construire des composants modulaires qui peuvent s'adapter sans réécrire la logique centrale facilite l'ajustement lorsque de nouvelles étapes ou réglementations entrent en jeu.

Enfin, concentrez-vous sur la fourniture uniquement des données dont les utilisateurs ont vraiment besoin. Surcharger les interfaces avec des informations inutiles ralentit les performances et encombre l'expérience. Les vues basées sur les rôles peuvent aider à maintenir les choses simplifiées, assurant des temps de chargement rapides même lorsque des centaines d'utilisateurs accèdent aux données simultanément.

Une fois que vous avez cartographié les besoins des utilisateurs, il est temps de décider si vous souhaitez créer un outil personnalisé ou utiliser une plateforme de générateur d'applications.

Construire ou acheter : faire le bon choix

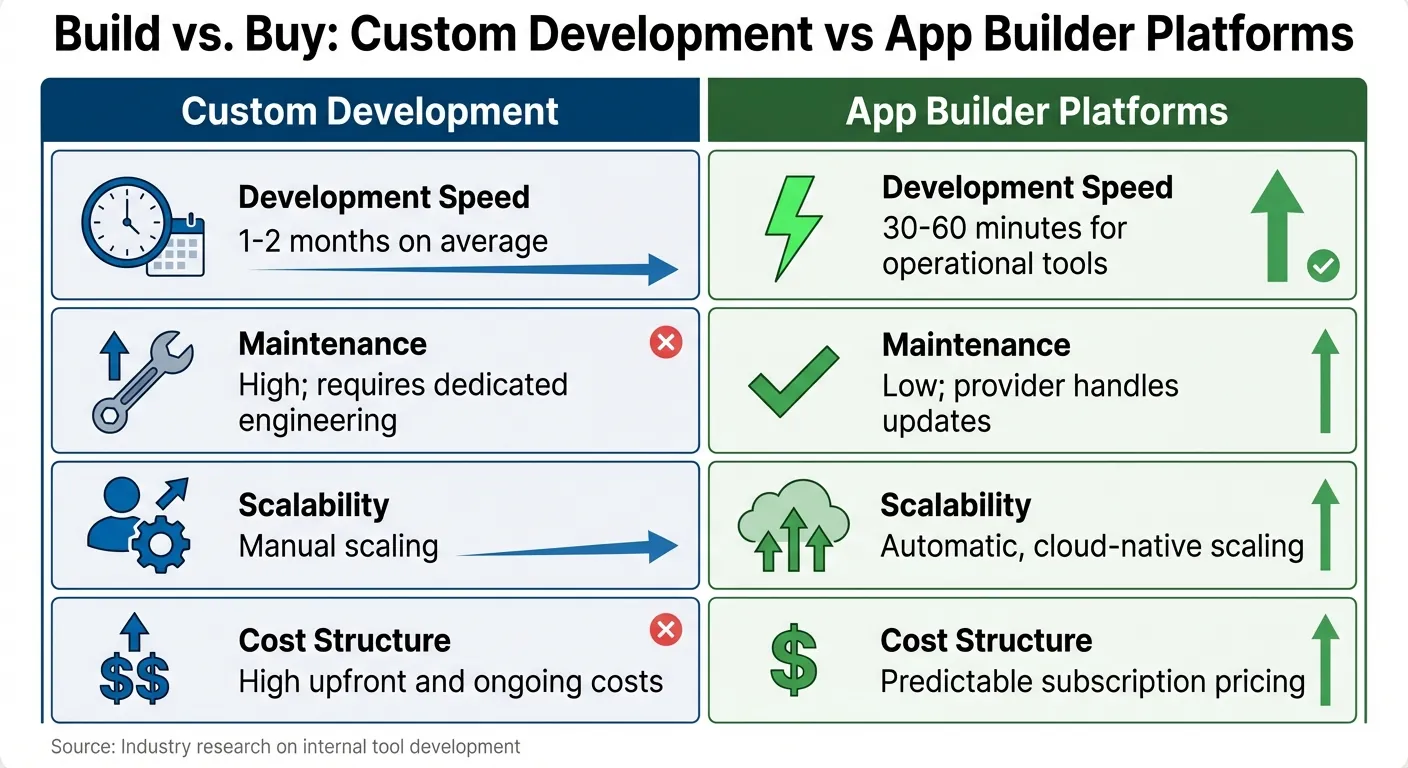

Avec les flux de travail définis, vous devrez peser les avantages et les inconvénients du développement personnalisé par rapport aux plateformes de générateurs d'applications. Le développement personnalisé nécessite souvent une grande équipe d'ingénierie, un budget plus important et plusieurs mois pour livrer un seul outil. D'autre part, les plateformes de générateurs d'applications peuvent réduire considérablement ce délai - certains outils peuvent être créés en moins d'une heure.

Le coût est un autre facteur. Les outils personnalisés entraînent des dépenses de maintenance continue, y compris les mises à jour et les correctifs de sécurité. Les générateurs d'applications, en revanche, offrent une tarification prévisible basée sur abonnement.

| Facteur | Développement personnalisé | Plateformes de générateurs d'applications |

|---|---|---|

| Vitesse de développement | 1 à 2 mois en moyenne | 30 à 60 minutes pour les outils opérationnels |

| Maintenance | Élevé ; nécessite une équipe d'ingénierie dédiée | Faible ; le fournisseur gère les mises à jour |

| Évolutivité | Mise à l'échelle manuelle | Mise à l'échelle automatique native du cloud |

| Structure de coût | Coûts initiaux et continus élevés | Tarification d'abonnement prévisible |

Le développement personnalisé a du sens lorsque votre outil doit répondre à des exigences techniques très spécifiques que les plateformes prêtes à l'emploi ne peuvent pas gérer. Mais pour la plupart des outils internes - comme les tableaux de bord, les flux d'approbation ou les systèmes de saisie de données - les générateurs d'applications sont plus rapides, moins chers et plus faciles à mettre à l'échelle.

L'intégration est une autre considération critique. Vérifiez si une plateforme offre des API ouvertes et des connecteurs préconfigurés pour vos outils existants, comme Microsoft 365, Slack ou les bases de données existantes. Des plateformes comme Adalo peuvent s'intégrer à des sources de données telles que Airtable, Google Sheets, MS SQL Server et PostgreSQL. Elles prennent même en charge les systèmes sans API grâce à l'intégration DreamFactory [blue.adalo.com]. Cela évite les silos de données et prévient la « dette d'intégration » qui accompagne souvent les solutions personnalisées.

Enfin, évaluez les capacités d'administration de la plateforme. Les chefs de département peuvent-ils gérer leur propre contenu et leurs autorisations sans l'aide de l'informatique ? Et assurez-vous que la plateforme prend en charge un nombre illimité d'utilisateurs simultanés, pas seulement le nombre total d'utilisateurs, pour éviter les plantages lors d'événements à fort trafic comme les réunions avec tout le monde.

Conception pour la scalabilité

Quand il s'agit de créer des outils qui peuvent croître avec vos besoins, la conception modulaire est la clé. En divisant votre outil en modules distincts - comme l'interface utilisateur, la logique métier et les données - vous pouvez effectuer des mises à jour ou des modifications sans affecter tout le système.

Imaginez-le comme construire avec des briques LEGO au lieu de sculpter une statue dans un bloc solide. Cette méthode, connue sous le nom de couplage faible, garantit que chaque partie de votre système communique par des interfaces claires plutôt que d'être étroitement liées. De cette façon, vous pouvez remplacer ou mettre à niveau des composants individuels sans tout démanteler. Pour les systèmes monolithiques plus anciens, vous pouvez progressivement passer à des services modulaires en utilisant le modèle « Strangler ».

Un autre avantage de la conception modulaire est la réutilisabilité. Encapsulez la logique et les éléments d'interface utilisateur pour qu'ils puissent être réutilisés dans vos applications. Cette approche réduit la redondance et simplifie les mises à jour - corrigez un composant une fois, et les modifications s'appliquent automatiquement partout où il est utilisé. Associez cela à un langage de conception normalisé - navigation cohérente, palettes de couleurs et conventions de nommage - et vous non seulement rendrez l'intégration plus facile pour les utilisateurs, mais améliorerez également l'efficacité des développeurs. Ces stratégies s'alignent avec les efforts de planification des capacités précédents, aidant votre système à gérer la demande croissante des utilisateurs sans ralentir.

Les performances sont importantes aussi. Maintenez les charges de données sous 1,6 MB et assurez-vous que les requêtes s'exécutent en moins de 3 secondes. Si votre outil doit afficher de grands ensembles de données, utilisez la pagination côté serveur pour éviter de charger tout d'un coup. Les tableaux qui dépendent du client peuvent confortablement gérer jusqu'à 1 000 lignes mais commencent à ralentir au-delà de 5 000 lignes.

Conception modulaire et réutilisabilité des composants

En développant l'approche modulaire, la conception pour la réutilisabilité des composants peut réduire considérablement les maux de tête de maintenance. En divisant votre système en petites unités indépendantes, vous pouvez tester, mettre à jour et déployer chaque module sans perturber l'application entière. C'est particulièrement utile pour les outils qui gèrent plusieurs tâches - comme la gestion des stocks tout en supportant le service client - en assurant qu'une fonction ne ralentit pas l'autre.

Lorsque des mises à jour ou des corrections de bogues sont nécessaires, vous modifiez le module, et chaque application l'utilisant en bénéficie immédiatement. La normalisation joue un rôle crucial ici. La cohérence dans la navigation, le placement des boutons et les palettes de couleurs facilite pour les utilisateurs de passer d'un outil à l'autre sans avoir besoin de réapprendre les interfaces. Pour les développeurs, commencer avec des modèles normalisés garantit que chaque nouvel outil est construit sur une base sécurisée et conforme, complète avec des autorisations pré-approuvées et des paramètres de déploiement.

Pour les outils plus complexes, envisagez de diviser les applications monopage en architectures multipages. Cette approche améliore les temps de chargement et simplifie la maintenance, surtout quand différentes équipes sont responsables de diverses sections de l'outil. Déplacez les tâches lourdes comme les transformations de données, le filtrage et le tri vers le côté serveur pour garder le côté client fonctionnant correctement.

| Métrique de performance | Seuil d'impact modéré | Seuil d'impact grave |

|---|---|---|

| Taille de la charge de requête | > 1,6 MB | > 3 MB |

| Temps d'exécution de la requête | > 3 secondes | > 5 secondes |

| Lignes de tableau côté client | > 1 000 lignes | > 5 000 lignes |

| Temps d'exécution du transformateur | > 200 ms | > 500 ms |

Contrôle d'accès basé sur les rôles et sécurité

Tandis que la conception modulaire garantit la scalabilité, Le contrôle d'accès basé sur les rôles (RBAC) maintient votre système sécurisé à mesure qu'il grandit. La gestion des autorisations individuelles des utilisateurs peut rapidement devenir écrasante, mais RBAC simplifie cela en regroupant les utilisateurs dans des rôles comme « Représentant commercial », « Responsable » ou « Administrateur ». Les autorisations sont attribuées aux rôles, pas aux individus, donc quand quelqu'un change d'équipe ou se joint, vous n'avez besoin que de mettre à jour son rôle pour ajuster son accès. Cette approche protège également votre système des modifications non autorisées.

Centralisez l'authentification des utilisateurs avec des solutions d'authentification unique (SSO) comme Okta ou Microsoft Active Directory. Ces outils rationalisent les processus de connexion et appliquent le Principe du Moindre Privilège, en veillant à ce que les utilisateurs n'aient accès qu'à ce dont ils ont besoin pour accomplir leur travail. Par exemple, un représentant commercial ne peut afficher que les données des clients, tandis qu'un gestionnaire financier peut modifier les factures mais ne verra pas les dossiers des ressources humaines.

Pour renforcer davantage la sécurité, définissez des politiques de portée basées sur le risque. Les actions à faible risque, comme l'envoi de messages, peuvent être sans restriction. Les tâches à risque modéré, comme l'accès aux données des clients, peuvent nécessiter une approbation, tandis que les actions à haut risque, comme la suppression de bases de données, doivent être limitées à un petit groupe d'administrateurs de confiance. Automatisez les audits de sécurité pour signaler les autorisations trop larges ou détecter les utilisateurs non autorisés.

L'auditabilité est également essentielle. Chaque action doit être traçable jusqu'à un utilisateur et un rôle spécifiques, ce qui facilite le suivi de l'accès et le respect des normes de conformité au fur et à mesure de votre croissance. Utilisez des environnements de Développement, Test, Préproduction et Production séparés pour assurer la sécurité des données en direct. Pour les intégrations d'API externes, évitez de coder en dur les jetons ; au lieu de cela, utilisez des outils de gestion des secrets comme HashiCorp Vault ou AWS Secrets Manager pour gérer les credentials de manière sécurisée.

| Fonctionnalité | Autorisations Individuelles | Le contrôle d'accès basé sur les rôles (RBAC) |

|---|---|---|

| Effort de Gestion | Élevé ; nécessite des mises à jour manuelles pour chaque utilisateur. | Faible ; les autorisations sont mises à jour par rôle/groupe. |

| Évolutivité | Faible ; ingérable à mesure que le nombre d'utilisateurs augmente. | Élevé ; prend en charge facilement les grandes bases d'utilisateurs. |

| Risque de Sécurité | Élevé ; sujet aux erreurs et à l'« augmentation des permissions ». | Faible ; applique le principe du Moindre Privilège. |

| Auditabilité | Difficile ; difficile de suivre l'accès des utilisateurs. | Simple ; l'accès est lié à des rôles définis. |

Intégration avec les Sources de Données Existantes

L'utilité de vos outils internes dépend fortement des données auxquelles ils peuvent accéder. De nombreuses organisations ont des informations cruciales enfermées dans des bases de données, des feuilles de calcul ou des systèmes plus anciens qui précèdent les normes d'intégration modernes. Le véritable obstacle n'est pas seulement de se connecter à ces sources - c'est de le faire d'une manière qui peut croître avec votre équipe et gérer des volumes de données croissants. Voici un aperçu de certaines méthodes efficaces pour intégrer des sources de données diverses dans un environnement d'outils évolutif.

Connexion aux Bases de Données et Systèmes Hérités

Commencez par examiner les systèmes que vous possédez déjà. Les générateurs d'applications modernes peuvent se connecter directement à des bases de données populaires comme PostgreSQL, MS SQL Server, MySQL, et même à des outils basés sur le cloud comme Airtable et Google Sheets. Cela élimine le besoin de dupliquer les données ou de maintenir des copies obsolètes. Lors de la liaison à des bases de données, concentrez-vous sur l'interrogation des seuls champs dont vous avez besoin. Cela maintient les charges utiles gérables et assure des temps de réponse rapides, qui sont cruciaux à mesure que votre base d'utilisateurs et vos données augmentent.

Les systèmes hérités, cependant, peuvent être plus délicats. De nombreux anciens systèmes de planification des ressources de l'entreprise (ERP) et mainframes ont été construits bien avant que les API ne deviennent standard. Sans API, vous aurez besoin de stratégies d'intégration alternatives. Voici quelques options à considérer :

- Intégration au niveau de la base de données: Interrogez directement la base de données du système hérité pour un accès rapide. Cependant, cette méthode peut être fragile - tout changement au schéma de la base de données pourrait perturber votre connexion.

- Intégration basée sur les fichiers: Utilisez les exportations CSV ou XML pour les mises à jour par lots. C'est idéal pour les mises à jour nocturnes lorsque la synchronisation en temps réel n'est pas cruciale.

- Automatisation des Processus Robotisés (RPA): Simulez les interactions des utilisateurs avec les systèmes qui n'ont pas d'accès programmatique. Bien qu'efficace pour certaines tâches, cette méthode est sujette aux ruptures avec même des changements mineurs à l'interface utilisateur.

« Le screen scraping est très fragile et exige une maintenance constante. » - Dheeraj Vema

Une solution plus évolutive consiste à envelopper les systèmes hérités avec des API en utilisant des outils comme DreamFactory. Cela crée une couche d'interface moderne, permettant à ces systèmes plus anciens de fonctionner comme des points de terminaison standard sans modifier leur structure fondamentale. Adalo, par exemple, s'intègre à DreamFactory via Adalo Blue, permettant aux équipes d'extraire des données des systèmes hérités directement dans leurs applications.

Lors du choix d'une méthode d'intégration, réfléchissez à la question de savoir si vous avez besoin d'une communication synchrone ou asynchrone. Les méthodes synchrones, comme « Demande et Réponse », sont meilleures lorsque les utilisateurs ont besoin de réponses immédiates. Les méthodes asynchrones, comme « Déclencher et Oublier », fonctionnent mieux pour les processus d'arrière-plan et aident à réduire les goulots d'étranglement du trafic pendant les heures de pointe.

Mises à jour unifiées sur toutes les plateformes

Une fois vos sources de données connectées, l'étape suivante consiste à assurer que les mises à jour sont cohérentes sur toutes les plateformes. Par exemple, si un représentant commercial met à jour un enregistrement de client sur son téléphone, cette modification devrait apparaître instantanément sur le tableau de bord web et dans les rapports. Les approches traditionnelles nécessitent souvent des builds séparées pour iOS, Android et le web, ce qui peut entraîner une « dérive logique » car chaque plateforme gère les données différemment.

Les plateformes à codebase unique éliminent ce problème. Avec Adalo, par exemple, vous n'avez besoin de construire votre application qu'une seule fois. Toute mise à jour de la base de données, de la logique métier ou de l'interface s'applique automatiquement sur le web, iOS et Android. Cette approche unifiée non seulement économise du temps, mais assure également que les utilisateurs voient des informations cohérentes, indépendamment de la façon dont ils accèdent à votre outil.

Pour maintenir la vitesse et la fiabilité, transférez les transformations de données lourdes au serveur. Les bibliothèques de requêtes partagées peuvent en outre normaliser la manière dont les données sont extraites, les métriques sont calculées ou les enregistrements sont filtrés. Cela signifie que toute mise à jour de ces processus bénéficie immédiatement à tous les outils connectés.

« Les applications doivent éliminer l'accès direct aux données, en s'appuyant plutôt sur l'automatisation et les mécanismes pour standardiser la récupération et la modification des données. » - Cadre bien architecturé de Retool

Optimisation des Performances à l'Échelle

À mesure que votre équipe grandit et que les outils internes gèrent des quantités croissantes de données, le maintien des performances devient essentiel. Ce qui fonctionne sans effort pour un petit groupe peut s'arrêter complètement sous une utilisation intensive. La différence entre un petit projet pilote et une solution entièrement évolutive réside souvent dans l'identification proactive et la résolution des goulots d'étranglement avant qu'ils n'impactent la productivité. Voici comment garder vos outils fonctionnant correctement à mesure que la demande augmente.

Analyse des Performances Pilotée par l'IA

Les diagnostics modernes aident à détecter les problèmes de performance tôt, pendant la phase de développement. Ces outils analysent le comportement de votre application et mettent en évidence des problèmes spécifiques, tels que les charges utiles de données surdimensionnées, les requêtes lentes ou les goulots d'étranglement des ressources du navigateur. En identifiant ces problèmes, vous pouvez faire des corrections avant qu'elles ne deviennent des problèmes plus importants.

Par exemple, les insights de conception modulaire travaillent main dans la main avec les diagnostics de performance pour assurer que vos outils restent réactifs, même sous charge importante. Les petites charges utiles de données et les requêtes efficaces maintiennent les interfaces fluides, tandis que les transferts de données volumineux ou les processus lents peuvent entraîner des expériences utilisateur lentes. Quelque chose d'aussi simple que de maintenir les tableaux rendus par le navigateur à un nombre de lignes raisonnable peut prévenir les problèmes de défilement causés par la surcharge du navigateur.

Une tactique clé consiste à déléguer les tâches gourmandes en ressources au serveur. Le traitement côté serveur non seulement maintient l'interface rapide, mais réduit également la charge sur les appareils des utilisateurs. L'exécution des requêtes en parallèle - en utilisant des méthodes comme Promise.all() en JavaScript - peut optimiser davantage les performances en permettant à plusieurs demandes de données de être traitées simultanément au lieu de séquentiellement.

Mise en cache et mise à l'échelle automatique

Après avoir diagnostiqué les goulots d'étranglement, la mise en cache et la mise à l'échelle automatique fournissent des solutions puissantes pour les traiter en temps réel. La mise en cache stocke les données fréquemment consultées, éliminant le besoin de les récupérer à plusieurs reprises dans la base de données. Cela est particulièrement utile pour les outils internes où certains tableaux de bord ou rapports sont consultés plusieurs fois par jour. Pour les applications mobiles, l'activation d'options de mise en cache comme « Mettre en cache le chargement de la page » permet aux agents de terrain de continuer à utiliser les outils même dans les zones avec une connectivité médiocre.

La mise à l'échelle automatique, en revanche, ajuste dynamiquement votre infrastructure pour répondre à la demande. Par exemple, lors des pics d'utilisation - comme les lundis matin ou les rapports de fin de mois - des instances de serveur supplémentaires peuvent être lancées pour gérer le pic de trafic. Une fois que la demande diminue, ces ressources se réduisent, assurant des performances cohérentes sans gaspiller la capacité matérielle.

Pour gérer des volumes de données élevés, la mise à l'échelle des processeurs de flux de travail est tout aussi importante. L'augmentation des limites de concurrence - par exemple, en définissant WORKFLOW_TEMPORAL_CONCURRENT_TASKS_LIMIT à 100 - empêche les tâches d'être mises en file d'attente pendant les périodes occupées. Avec ces stratégies, vos outils peuvent croître avec votre équipe, gérant l'augmentation des demandes sans intervention manuelle constante.

Sécurité et gouvernance à l'échelle

Au fur et à mesure que les outils internes se complexifient, les risques de sécurité augmentent également. La mise à l'échelle sécurisée signifie aller au-delà des protections isolées pour créer des systèmes intégrés d'identité et de conformité. Sans ces mesures, une seule identifiant compromis pourrait entraîner des pertes de millions de dollars et exposer des informations sensibles. En 2026, le coût moyen d'une violation de données a atteint 4,88 millions de dollars, l'erreur humaine ou la négligence jouant un rôle dans 68 % des incidents. Pour les organisations centrées sur le travail à distance, les risques sont encore plus élevés, car les coûts des violations ont tendance à être plus graves.

La clé de la mise à l'échelle sécurisée réside dans la gestion centralisée des identités. Mettre en œuvre l'authentification unique (SSO) est une étape critique pour éliminer les identifiants multiples et réduire les risques d'erreurs liées aux mots de passe. Les solutions SSO, telles que Okta ou Microsoft Active Directory, fournissent un point d'authentification unique, rationalisant la sécurité. Cependant, une gestion efficace des identités et des stratégies de permissions sont essentielles pour relever pleinement les défis de la mise à l'échelle sécurisée.

Authentification unique et gestion des permissions

SSO, lorsqu'il est associé au contrôle d'accès basé sur les rôles (RBAC), applique le principe du moindre privilège. Cette approche garantit que les utilisateurs et les services n'ont que les permissions nécessaires pour effectuer leurs rôles spécifiques. Par exemple, un analyste en marketing n'a pas besoin d'accès aux données de paie, et un technicien de terrain ne devrait pas pouvoir modifier les prix des stocks. Limiter les permissions de cette manière réduit considérablement les dégâts qu'un compte compromis peut causer.

Au lieu de donner un accès direct aux données brutes, les utilisateurs doivent être regroupés en niveaux de permissions standardisés. Ces niveaux peuvent inclure des catégories comme « Toujours autorisé » pour les actions à faible risque (par exemple, consulter les rapports de base), « Nécessite une approbation » pour l'accès sensible (par exemple, les dossiers clients), et « Restreint » pour les modifications administratives à haut risque.

Pour minimiser davantage les risques, la rotation des jetons peut renouveler automatiquement et expirer les identifiants, réduisant la fenêtre d'exposition des jetons compromis. L'ajout de restrictions d'adresse IP qui permettent l'accès aux outils internes uniquement à partir de plages d'adresses autorisées crée une couche de défense supplémentaire. Des outils comme AWS Secrets Manager ou HashiCorp Vault aident à sécuriser les jetons en les injectant au moment de l'exécution, évitant les risques des identifiants codés en dur.

Maintien des pistes d'audit et du contrôle de version

L'accès sécurisé n'est qu'une partie du puzzle. La surveillance transparente est essentielle pour une gouvernance évolutive. Les pistes d'audit complètes offrent une visibilité sur les actions des utilisateurs, les modifications de configuration et l'accès aux données. Ces journaux doivent inclure des métadonnées - telles que qui a effectué la modification, quand elle s'est produite, ce qui a été modifié et l'adresse IP d'origine. Ces dossiers détaillés sont essentiels pour la conformité et pour enquêter sur les incidents de sécurité potentiels.

Pour les configurations d'outils internes, les systèmes de contrôle de version comme Git sont inestimables. L'utilisation de demandes d'extraction pour les modifications garantit que chaque modification subit un examen humain avant le déploiement. Ce processus crée non seulement un historique clair des modifications, mais permet également des restaurations rapides à un état stable si nécessaire.

Les organisations en croissance rapide peuvent également bénéficier de la surveillance de conformité automatisée pour détecter les problèmes rapidement. Des outils comme AWS Config évaluent continuellement les configurations des ressources par rapport aux normes de gouvernance, signalant automatiquement toute violation. Par exemple, Snowflake a mis en place un tableau de bord centralisé pour gérer l'accès des utilisateurs aux outils internes, ce qui a réduit les erreurs et les tickets de correction manuelle de 65%. Les audits automatisés réguliers des étendues d'applications et des collaborateurs aident à assurer que l'accès reste aligné avec les politiques organisationnelles à mesure que les équipes se développent.

Créer des outils internes évolutifs avec Adalo

La création d'outils internes qui peuvent évoluer efficacement nécessite une plateforme qui combine la rapidité avec une fiabilité de niveau entreprise. Adalo relève le défi avec sa génération d'applications basée sur l'IA et son infrastructure solide, permettant aux équipes de déployer des applications fonctionnelles en quelques jours. En tirant parti d'une architecture à base de code unique, Adalo garantit que les mises à jour s'appliquent de manière transparente sur les plateformes web, iOS et Android. Cela élimine les expériences utilisateur fragmentées qui compliquent souvent les écosystèmes d'outils internes, facilitant le maintien de la cohérence et de l'efficacité.

Génération d'applications assistée par l'IA

AI Builder d'Adalo transforme des invites en langage naturel simple en applications entièrement fonctionnelles. Qu'une équipe ait besoin d'un suivi des stocks ou d'un outil de gestion du service sur le terrain, elle peut décrire les exigences, et l'IA fait le reste - construisant tout, de la structure de la base de données aux flux utilisateur et aux écrans. Ce processus réduit l'effort manuel, standardise le développement et minimise les erreurs généralement associées aux méthodes de codage traditionnelles.

Les tâches de maintenance, qui dépensent souvent les ressources des développeurs, sont également rationalisées par l'IA. La plateforme génère automatiquement des notes de déploiement et des résumés de solution, épargnant aux équipes du travail de documentation fastidieux. Par exemple, si une équipe souhaite ajouter un nouveau flux de travail d'approbation, elle peut décrire la fonctionnalité en langage simple, et Adalo l'intègre directement à l'application - aucun codage ni configuration complexe requise.

Fonctionnalités d'entreprise avec Adalo Blue

Le développement rapide n'est que la moitié de l'équation ; la sécurité de niveau entreprise et l'intégration sont tout aussi critiques. Adalo Blue offre ces capacités avec des fonctionnalités telles que l'authentification unique (SSO), l'intégration Active Directory et le contrôle d'accès basé sur les rôles (RBAC). Ces outils garantissent une gestion centralisée des utilisateurs et appliquent l'accès au moindre privilège dès le départ, évitant le besoin de mesures de sécurité ajoutées ultérieurement.

De plus, Adalo Blue simplifie le travail avec les systèmes hérités grâce à DreamFactory, qui permet aux équipes de créer des tableaux de bord unifiés même lorsqu'il s'agit de systèmes obsolètes ou limités en API. Cela signifie que les données précieuses peuvent être mises en surface et utilisées sans avoir besoin de rénovations système coûteuses.

Mise à l'échelle de l'infrastructure pour un MAU élevé

L'infrastructure modulaire d'Adalo est conçue pour gérer la croissance, supportant plus d'1 million d'utilisateurs actifs mensuels avec facilité. En standardisant la pile logicielle sur toutes les plateformes, la plateforme garantit des performances cohérentes, peu importe l'échelle. Pour les organisations ayant des demandes d'utilisation particulièrement élevées, Adalo Blue offre des options d'infrastructure dédiée et de déploiement sur site pour maintenir la fiabilité à mesure que le nombre d'utilisateurs augmente.

Pour éviter les problèmes de performance, Adalo inclut une fonctionnalité X-Ray alimentée par l'IA qui identifie les goulots d'étranglement pendant le développement. En détectant ces problèmes rapidement, les équipes peuvent éviter les correctifs coûteux après le lancement et assurer une expérience fluide pour les utilisateurs, même à l'échelle.

Conclusion

La création d'outils internes évolutifs ne consiste pas à deviner tous les besoins futurs - c'est commencer avec les bons éléments de base. Une base solide enracinée dans la conception modulaire, l'optimisation des performances côté serveur, et l'intégration transparente intégration avec les systèmes existants jette les bases des outils qui grandissent avec votre organisation. En standardisant les cadres de gouvernance, en utilisant les contrôles d'accès basés sur les rôles et en gardant les environnements de développement et de production séparés, vous ne construisez pas seulement des outils - vous créez une infrastructure qui évolue sans rénovations coûteuses.

La clé des outils qui prospèrent sous la pression réside souvent dans les choix architecturaux précoces. Des stratégies comme l'approche par unité d'échelle et la pagination côté serveur garantissent que les applications restent rapides et réactives, même lorsqu'elles gèrent des milliers d'enregistrements. Les leaders du secteur ont montré comment une architecture interne robuste peut générer des résultats réels.

Des plateformes comme Adalo rendent ce processus plus rapide et plus efficace. Avec des fonctionnalités prêtes pour l'entreprise comme SSO, RBAC et l'analyse de performance alimentée par l'IA intégrées, vous pouvez passer du prototype à la production en quelques heures. Mettez à l'échelle sans effort pour supporter plus d'1 million d'utilisateurs actifs mensuels, tandis que des outils comme AI Builder automatisent les tâches répétitives, et X-Ray identifie les problèmes de performance avant qu'ils ne deviennent des problèmes. En adoptant ces solutions, vos outils internes peuvent croître avec votre entreprise, relevant les défis sans manquer un coup.

Articles de blog connexes

- Comment permettre aux employés de construire les applications dont ils ont besoin

- Mise à l'échelle d'applications sans code pour de grands ensembles de données

- Permissions basées sur les rôles pour les outils internes

- Comment faire évoluer les MVP sans reconstruction

FAQ

Comment la conception modulaire aide-t-elle à créer des outils internes évolutifs ?

La conception modulaire simplifie la création d'outils internes évolutifs en les divisant en composants plus petits et autonomes. Chaque module peut être développé, testé et mis à jour indépendamment, ce qui facilite l'introduction de nouvelles fonctionnalités ou l'amélioration des fonctionnalités sans perturber le reste du système. Cette approche garantit que vos outils peuvent croître en douceur avec les besoins de votre entreprise.

La division des outils en modules séparés améliore également les performances. Les équipes peuvent identifier et résoudre les goulots d'étranglement plus rapidement, affiner les composants spécifiques et allouer les ressources plus efficacement. De plus, la conception modulaire prend en charge un développement plus rapide et étape par étape, permettant aux organisations de publier rapidement des mises à jour ou de nouvelles fonctionnalités tout en maintenant les systèmes fiables et efficaces. C'est un moyen intelligent de construire des outils qui évoluent sans effort avec les demandes changeantes.

Quels sont les avantages de l'utilisation du contrôle d'accès basé sur les rôles (RBAC) pour sécuriser les outils internes ?

Le contrôle d'accès basé sur les rôles (RBAC) apporte une gamme d'avantages en ce qui concerne la sécurisation des outils internes. En liant les permissions d'accès à des rôles spécifiques plutôt qu'à des individus, il garantit que les utilisateurs ne peuvent interagir qu'avec les données et les fonctionnalités pertinentes pour leurs fonctions professionnelles. Cela réduit la probabilité d'accès non autorisé, de risques internes ou de violations de données potentielles, donnant aux organisations un contrôle plus strict sur les informations sensibles.

Un autre avantage clé du RBAC est la façon dont il simplifie la conformité. Avec des politiques d'accès clairement définies, les organisations peuvent facilement démontrer leur respect des réglementations comme GDPR, HIPAA ou ISO 27001. Ces politiques sont faciles à auditer, ce qui rend les exigences réglementaires moins problématiques. En plus de cela, le RBAC améliore l'efficacité opérationnelle. Au lieu de gérer les permissions pour chaque utilisateur manuellement, les administrateurs peuvent les affecter au niveau du rôle. Cela non seulement fait gagner du temps mais garantit également la cohérence et rend la mise à l'échelle plus facile à mesure que les équipes se développent ou que les rôles changent.

En bref, le RBAC renforce la sécurité, simplifie les efforts de conformité et réduit la complexité de la gestion des permissions, ce qui en fait un outil essentiel pour construire des systèmes internes sécurisés et évolutifs.

Pourquoi est-il essentiel de planifier l'évolutivité lors de la création d'outils internes ?

Planifier la croissance dès le départ garantit que vos outils internes peuvent s'étendre parallèlement à votre entreprise sans sacrifier les performances. À mesure que les demandes des utilisateurs augmentent, les volumes de données s'accroissent et les opérations deviennent plus complexes, les outils conçus pour s'adapter aident à éviter les ralentissements, les pannes ou les révisions coûteuses du système.

En tenant compte de la scalabilité dès le départ, vous préparez vos outils à relever les défis futurs, en s'adaptant aux besoins changeants sans gaspiller du temps ni des ressources. Cette stratégie prospective maintient vos opérations efficaces et soutient une croissance fluide et ininterrompue.

Explorez le créateur d'applications pour outils internes d'Adalo pour commencer à créer.

Créez votre application rapidement avec l'un de nos modèles d'application prédéfinis

Commencez à créer sans code