Les API héritées ont souvent du mal à suivre les demandes modernes, ce qui entraîne des temps de réponse lents, des utilisateurs frustrés et des coûts accrus. La bonne nouvelle ? Vous n'avez pas besoin d'une refonte complète pour améliorer les performances. Voici comment vous pouvez résoudre les problèmes les plus courants :

Pour les équipes cherchant à moderniser sans ressources de codage importantes, des plateformes comme Adalo, un créateur d'application sans code pour les applications web pilotées par base de données et les applications natives iOS et Android—une seule version sur les trois plateformes, publiées sur l'App Store Apple et Google Play, offrent une alternative pratique. Ces outils vous permettent de créer des applications modernes connectées à des API tout en supprimant progressivement les systèmes hérités.

- Architecture obsolète: Les systèmes monolithiques et les anciens protocoles comme HTTP/1.1 créent des goulots d'étranglement. Le passage aux microservices ou la mise à niveau vers HTTP/2/3 peut améliorer l'efficacité.

- Récupération de données inefficace: Les requêtes sans index, les appels redondants et les problèmes N+1 ralentissent les choses. L'optimisation des requêtes, l'ajout d'index et l'utilisation du regroupement de connexions peuvent accélérer les opérations.

- Manque de mise en cache: Sans mise en cache, les API traitent à plusieurs reprises les mêmes demandes. L'implémentation de la mise en cache au niveau des bordures, au niveau de l'application et côté client peut réduire les temps de réponse jusqu'à 90 %.

Gains rapides:

- Ajoutez des couches de mise en cache (p. ex., Redis, Cloudflare).

- Optimisez les requêtes de base de données (p. ex., indexation, pagination).

- Utilisez des wrappers d'API pour les fonctionnalités modernes sans reconstruction.

Corrections à long terme:

- Passez progressivement aux microservices en utilisant des méthodes comme le motif Strangler Fig.

- Supervisez les performances avec des outils comme Prometheus ou Datadog.

- Incorporez l'IA pour des insights en temps réel et une mise à l'échelle prédictive.

Même des améliorations mineures - comme la mise en cache ou l'optimisation des requêtes - peuvent réduire considérablement la latence et améliorer l'expérience utilisateur. Commencez petit, mesurez l'impact et progressez vers un système plus moderne et efficace.

7 meilleures façons de multiplier par 10 votre performance d'API

Problèmes de performance courants dans les API héritées

Pour résoudre les problèmes de performance dans les API héritées, vous devez d'abord identifier ce qui cause le ralentissement. La plupart des problèmes entrent dans trois catégories : les conceptions de système obsolètes, la récupération de données inefficace et l'absence de mécanismes de mise en cache. Examinons chacun d'entre eux.

Ancienne architecture et protocoles

Les API héritées s'appuient souvent sur les architectures monolithiques, où toutes les fonctions sont étroitement regroupées dans une seule application. Cette configuration rend la mise à l'échelle inefficace—si un composant a besoin de plus de ressources, l'ensemble du système doit se mettre à l'échelle, ce qui augmente les goulots d'étranglement du trafic et centralise la charge du système.

Les protocoles utilisés par les anciens systèmes aggravent l'inefficacité. Les API basées sur SOAP ou les premières versions de REST souffrent fréquemment de surcharge de données, renvoyant de grands objets de données inutiles qui gaspillent la bande passante. Ces systèmes manquent souvent de connexions persistantes, nécessitant une nouvelle poignée de main TCP (et SSL/TLS) pour chaque demande. Beaucoup utilisent encore HTTP/1.1, qui traite les demandes de manière séquentielle et ne supporte pas le multiplexage comme HTTP/2 ou HTTP/3. Ce modèle synchrone ralentit davantage les opérations.

Un exemple concret ? Netflixla transition d'une structure monolithique vers les microservices avec l'edge computing a conduit à une amélioration de 70 % de la performance d'API. Cela souligne comment la modernisation de l'architecture peut avoir un impact spectaculaire sur les temps de réponse et l'expérience utilisateur.

Mauvaises méthodes de récupération de données

La façon dont les API héritées gèrent la récupération de données est un autre goulot d'étranglement courant. Les requêtes de base de données sans index forcent le système à scanner des tables entières, ce qui ralentit considérablement le traitement. Pire encore, les pratiques de codage inefficaces comme le problème de requête N+1—où plusieurs appels de base de données sont effectués au lieu de récupérer les données associées dans une seule requête—ajoutent des délais inutiles. Cela est particulièrement problématique pour les utilisateurs mobiles avec des connexions plus lentes.

Les autres inefficacités incluent les appels de données redondants, où les mêmes informations sont demandées plusieurs fois au cours d'une seule transaction, ou l'utilisation de boucles imbriquées qui amplifient les délais à mesure que les données augmentent. Les systèmes qui ouvrent et ferment fréquemment les connexions de base de données au lieu d'utiliser un pool de connexions connaissent également une latence plus élevée. Les outils de surveillance comme le temps jusqu'au premier octet (TTFB) ou l'exécution de la commande SQL EXPLAIN peuvent aider à identifier les goulots d'étranglement comme les index manquants.

Systèmes de mise en cache manquants

L'absence de mise en cache est un autre facteur de ralentissement des performances. Sans mise en cache, les API héritées régénèrent les mêmes réponses et répètent des requêtes de base de données identiques pour chaque demande. Cela non seulement augmente la latence, mais exerce également une pression constante sur les systèmes backend, surtout lors des pics de trafic.

L'absence de mise en cache périphérique ajoute d'autres retards, car les données doivent voyager du serveur central à l'utilisateur pour chaque demande. Les systèmes hérités s'appuient également fortement sur l'interrogation au lieu de modèles pilotés par les événements, ce qui est très inefficace—les nouvelles données ne sont récupérées que 1,5 % du temps lors de l'interrogation.

La mise en cache, bien que difficile dans les systèmes plus anciens, peut améliorer considérablement les performances. Cependant, elle nécessite une logique d'invalidation bien conçue, comme la purge déclenchée par événement ou des valeurs de durée de vie précises, pour assurer que les données restent à jour. Quand elle est bien exécutée, la mise en cache peut réduire les temps de réponse de l'API de 70 % à 90 % pour les réponses mises en cache, ce qui en fait l'un des moyens les plus efficaces de moderniser les performances.

Comment améliorer les performances des API héritées

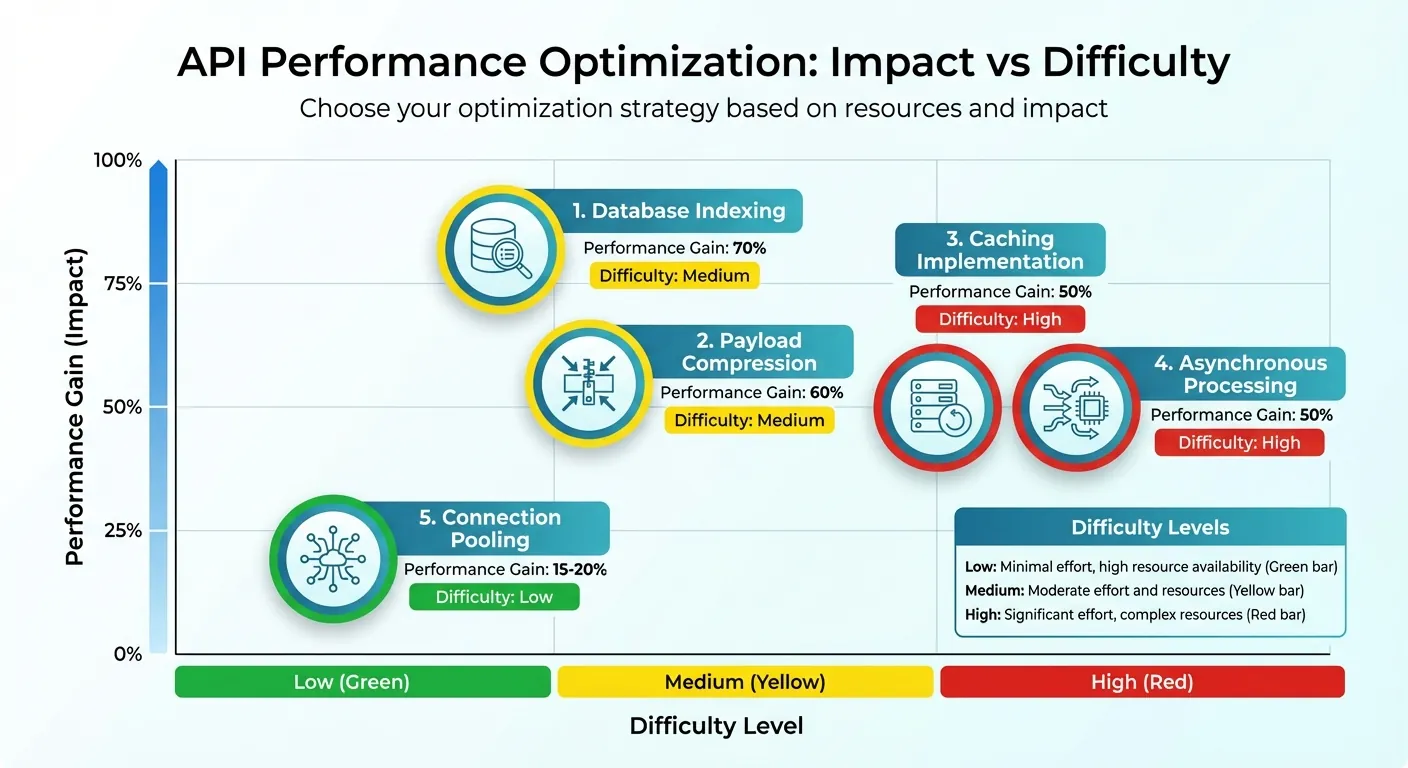

Techniques d'optimisation des performances des API : Comparaison impact vs difficulté

L'amélioration des performances des API héritées passe souvent par des stratégies intelligentes comme l'ajout de couches de mise en cache, l'affinage des requêtes de base de données et l'utilisation de wrappers API. Voici un examen plus approfondi de la façon dont ces méthodes peuvent faire la différence.

Ajout de couches de mise en cache

La mise en cache change la donne en matière d'accélération des réponses de l'API. En stockant temporairement les données fréquemment accédées, vous pouvez éviter les appels répétés à la base de données ou la régénération de la même sortie. Une stratégie de mise en cache multi-niveaux fonctionne mieux, en abordant différentes parties du système.

- Mise en cache périphérique: Les services comme Cloudflare ou Akamai stockent les données plus près des utilisateurs finaux, réduisant considérablement les temps d'attente—de centaines de millisecondes à seulement quelques-uns.

- Mise en cache au niveau de l'application: Des outils comme Redis ou Memcached gèrent la mise en cache côté serveur pour les requêtes de base de données lourdes ou les données calculées.

- Mise en cache côté client: Cela stocke les données immuables directement sur l'appareil ou le navigateur de l'utilisateur.

Vous pouvez également implémenter la mise en cache au niveau de la passerelle API pour assurer des politiques cohérentes entre les points de terminaison. Pour une mise en cache efficace, concentrez-vous sur trois facteurs clés :

- TTL (durée de vie): Définissez des durées appropriées en fonction de la fréquence des modifications des données.

- Clés de cache: Utilisez des en-têtes ou des paramètres d'URL pour identifier de manière unique les demandes.

- Stratégies d'invalidation: Mettez à jour les données mises en cache obsolètes pendant les heures creuses.

« S'il existe un super-héros de la réduction de la latence, c'est définitivement la mise en cache. Rien ne vaut éviter complètement une demande ! » - Zuplo

Les résultats parlent d'eux-mêmes. Par exemple, Xata a réduit la latence de l'API de 50 % en combinant l'informatique en périphérie et la mise en cache via le CDN de Cloudflare. Pour maximiser les avantages, surveillez le trafic pour les demandes répétitives et affinez les paramètres TTL pour équilibrer la fraîcheur et la vitesse.

Correction des requêtes de base de données

Souvent, les requêtes de base de données lentes sont le principal coupable derrière les API lentes. L'optimisation de ces requêtes peut améliorer considérablement les temps de réponse avec des modifications d'infrastructure minimales.

- Indexation: Appliquez des index aux colonnes fréquemment interrogées, en particulier celles utilisées dans les clauses WHERE, JOINs ou ORDER BY. Cela peut réduire le temps d'exécution des requêtes jusqu'à 90 %.

- Récupération de données sélectives: Évitez d'utiliser

SELECT *. À la place, récupérez uniquement les colonnes dont vous avez besoin, réduisant le traitement et la charge réseau. - Réécriture de requête: Simplifiez les requêtes en remplaçant les sous-requêtes par des JOINs ou des tables temporaires. Utilisez

EXISTSau lieu deINpour de meilleures performances dans les vérifications conditionnelles, et filtrez les données avecWHEREclauses plutôt queHAVING, car le premier est traité plus tôt. - Regroupement des connexions: Les connexions de base de données pré-établies économisent du temps en éliminant les frais généraux d'ouverture et de fermeture des connexions pour chaque demande. Cela peut améliorer les performances du système de 15 % à 20 %.

- Pagination: Divisez les grands ensembles de données en petits morceaux en utilisant

LIMITetOFFSETou des méthodes basées sur le curseur. Définissez des tailles de page par défaut (10–50 éléments) et des limites pour empêcher les demandes lourdes de surcharger le système.

| Technique d'optimisation | Gain potentiel de performances | Niveau de difficulté |

|---|---|---|

| Indexation de base de données | 70% | Moyen |

| Compression de charge utile | 60% | Moyen |

| Implémentation de mise en cache | 50% | Élevée |

| Traitement asynchrone | 50% | Élevée |

| Mise en pool des connexions | 15–20% | Faible |

Utilisation d'enveloppes API

Les enveloppes API offrent un moyen pratique de moderniser les systèmes hérités sans refonte complète. Agissant comme une couche de traduction, elles permettent aux anciens systèmes de communiquer avec les services plus récents de manière transparente. Les enveloppes centralisent des tâches telles que la sécurité, le routage et l'analyse, ce qui rationalise les opérations.

Les enveloppes optimisent également les performances en gérant l'authentification, la limitation de débit et la traduction de protocole. Elles peuvent réduire les charges utiles en supprimant les champs inutiles ou en convertissant les données dans des formats plus efficaces, ce qui accélère le traitement.

« Les intergiciels réduisent la complexité en traduisant les signaux entre les anciens systèmes et les services plus récents, améliorant l'interopérabilité sans nécessiter de refonte complète du système. » - Centre d'apprentissage Zuplo

Pour les systèmes avec des sources de données dispersées, GraphQL peut servir d'enveloppe, permettant aux clients de demander uniquement les données spécifiques dont ils ont besoin en une seule requête. Le déploiement d'enveloppes à la périphérie réduit davantage la latence en effectuant des opérations telles que l'authentification plus près des utilisateurs.

Les exemples pratiques mettent en évidence la valeur des enveloppes. Une équipe ayant des difficultés avec une API mobile bloquée à 40 transactions par seconde a introduit des API en couches avec traitement parallèle, mise en cache, pagination et regroupement de connexions. Ces modifications ont amené le système à 100 TPS. Les enveloppes simplifient l'intégration des systèmes hérités tout en les préparant aux demandes futures.

Moderniser les API héritées étape par étape

Prendre des mesures progressives pour moderniser les API héritées peut réduire considérablement les risques de migration. Cette approche est particulièrement importante si vous considérez que 83% des migrations de données échouent ou dépassent leur budget. En mettant à jour les systèmes progressivement, vous pouvez maintenir les fonctionnalités existantes tout en introduisant de nouveaux composants qui répondent aux demandes d'aujourd'hui.

Passage à une architecture de microservices

Diviser une API monolithique en microservices vous donne plus de contrôle sans nécessiter une refonte complète. Un moyen pratique d'y parvenir est d'appliquer le Modèle Figuier Étrangleur. Cela implique de placer une passerelle API—telle que Kong ou AWS API Gateway—entre vos clients et le système hérité. À partir de là, vous pouvez remplacer lentement les fonctions spécifiques par des microservices. Commencez par des composants à faible risque, routez un trafic minimal et développez à mesure que les performances répondent aux attentes.

Shopify a utilisé avec succès cette méthode en 2021 lors de la refonte de son modèle « Shop », un énorme « God Object » de 3 000 lignes. Ils ont réussi à maintenir les services en fonctionnement pour plus de 1 million de marchands tout en améliorant le temps de leur pipeline CI de 60 %—de 45 minutes à 18 minutes—et en réduisant les temps de déploiement à environ 15 minutes.

Les organisations qui adoptent cette stratégie signalent souvent des économies de coûts de 20–35% après la migration. Pour assurer la cohérence pendant la transition, vous pouvez implémenter des écritures de données simultanées dans les deux bases de données, ancienne et nouvelle. De plus, les disjoncteurs peuvent protéger le système en désactivant temporairement les points de terminaison en cas de défaillance, prévenant ainsi les perturbations généralisées.

Utilisation de l'IA pour la surveillance des performances

Les outils IA offrent un moyen proactif de surveiller les performances en analysant les modèles de trafic et en détectant les anomalies en temps réel. Ils peuvent tracer les problèmes de latence, suggérer des correctifs et même prédire la demande pour une meilleure allocation des ressources. La mise à l'échelle prédictive garantit que les ressources sont disponibles quand elles sont nécessaires, tandis que le routage intelligent du trafic dirige les utilisateurs vers les points de terminaison les plus rapides pendant le processus de migration.

Pour les tests, l'IA peut mettre à jour automatiquement les scripts de test cassés lorsque le logiciel change, réduisant le temps de maintenance manuelle de jusqu'à 70 %. Des outils comme StormForge analysent les données d'application pour recommander la meilleure allocation des ressources, ce qui peut aider à réduire les coûts du cloud sans sacrifier les performances.

Connexion avec les plateformes modernes

Moderniser les systèmes hérités ne signifie pas toujours recommencer à zéro. Des outils comme DreamFactory peuvent générer des API REST à partir de bases de données existantes en environ 5 minutes, transformant les anciens systèmes SOAP en interfaces REST JSON. Cette capacité, associée aux microservices et aux insights IA, étend les fonctionnalités des API héritées.

Ada, le créateur IA d'Adalo, vous permet de décrire ce que vous voulez et génère votre application. Magic Start crée des fondations d'applications complètes à partir d'une description, tandis que Magic Add ajoute des fonctionnalités en langage naturel.

Une fois ces API opérationnelles, les générateurs d'applications basés sur l'IA comme Adalo peuvent s'y connecter pour créer des applications mobiles et web modernes. La fonctionnalité Collections externes d'Adalo rend possible l'extraction de données à partir à la fois des microservices et des bases de données héritées, permettant des applications prêtes pour la production en quelques jours au lieu de mois. Le générateur AI Builder avec Magic Start d'Adalo génère des fondations d'applications complètes à partir de descriptions textuelles—décrivez ce que vous souhaitez construire, et il crée automatiquement votre structure de base de données, vos écrans et vos flux utilisateur.

Pour les équipes préoccupées par la scalabilité, l'infrastructure modulaire d'Adalo supporte les applications avec plus de 1 million d'utilisateurs actifs par mois, traitant plus de 20 millions de requêtes quotidiennes avec une disponibilité supérieure à 99 %. Contrairement aux enveloppes d'applications qui rencontrent des limitations de vitesse sous charge, cette architecture conçue à cet effet maintient les performances à l'échelle. À 36 $/mois sans limite sur les actions, les utilisateurs, les enregistrements ou le stockage, elle offre une tarification prévisible sans les frais basés sur l'utilisation qui rendent les autres plateformes imprévisibles.

Le groupe Jochen Schweizer mydays a adopté une approche graduée de la modernisation après une fusion. Ils ont maintenu une disponibilité de 100 % pendant la transition, réduit les temps de chargement des pages de 37 % et considérablement augmenté les taux de conversion. Leurs efforts leur ont valu le prix « Client de l'année » lors de Pimcore Inspire 2021.

Test et surveillance des performances au fil du temps

La modernisation des API héritées n'est pas une tâche ponctuelle—elle nécessite des tests et une surveillance constants pour maintenir les performances. L'objectif ? Détecter et corriger les problèmes avant qu'ils n'impactent les utilisateurs. La gestion des performances est un processus continu.

Test de charge et de stress

Différentes méthodes de test aident à découvrir les faiblesses spécifiques de l'API. Voici comment elles fonctionnent :

- Test de référence: Simule le trafic normal pour établir des références de performance.

- Test de pic: Imite les pics soudains de trafic, comme une campagne marketing virale, pour voir comment votre API gère les charges inattendues.

- Test de stress: Pousse votre API au-delà de ses limites pour identifier son point de rupture. Cela révèle si votre système échoue gracieusement avec une limitation de débit ou s'effondre complètement.

- Test de stabilité: Applique une charge modérée sur des périodes prolongées pour exposer les fuites de ressources, telles que les connexions de base de données non fermées ou les problèmes de mémoire, qui ne surgissent que dans le temps.

« Les tests de performance d'API sont tout au sujet de la réduction du risque d'échec. L'effort que vous investissez dans les tests de votre API doit être proportionnel à l'impact que sa défaillance aurait sur votre entreprise. » - Loadster

Recherchez les motifs « en crosse de hockey » dans les résultats de test—où le débit se stabilise soudainement, tandis que les temps de réponse et les erreurs montent en flèche. Des outils comme les Protocol Bots de Loadster peuvent automatiser les requêtes au niveau HTTP, éliminant les frais généraux du navigateur, tandis qu'EchoAPI décompose les requêtes en étapes détaillées du cycle de vie (par exemple, recherche DNS, établissement de liaison SSL/TLS, temps jusqu'au premier octet). Ces insights aident à identifier exactement où les retards se produisent. Pour des résultats réalistes, variez les charges utiles de vos tests avec diverses entrées au lieu de frapper à plusieurs reprises la même réponse en cache.

Ces tests jettent les bases d'une surveillance continue.

Surveillance des performances en temps réel

Tandis que les tests simulent des problèmes potentiels, la surveillance en temps réel détecte les problèmes au moment où ils se produisent. Des outils comme Prometheus, New Relic, Dynatrace, et Datadog offrent le traçage distribué, qui suit les demandes entre les services, vous donnant une visibilité approfondie de votre système. Même un petit délai—comme 100 millisecondes—peut réduire les taux de conversion de 7%.

Concentrez-vous sur les temps de réponse p95 et p99 (95e et 99e centiles) au lieu des moyennes. Ces métriques montrent comment les utilisateurs expérimentent votre API lors de trafic élevé ou de cas limites, pas seulement dans des conditions idéales. Configurez des tableaux de bord avec des alertes pour les écarts, par exemple lorsque les temps de réponse p95 dépassent 200 millisecondes. N'oubliez pas de surveiller les services tiers. Leurs problèmes peuvent impacter les performances de votre application, même si vos systèmes internes fonctionnent correctement.

Optimisation continue

Les tests et la surveillance ne sont que le début—l'optimisation continue garantit que votre API continue de s'améliorer. Par exemple, Xata a réduit la latence de l'API de 50% en utilisant le CDN de Cloudflare et l'edge computing pour traiter les demandes plus près des utilisateurs. De même, Netflix a amélioré les performances de l'API de 70% en déployant des microservices à la périphérie, réduisant ainsi la distance que les données doivent parcourir entre les clients et les serveurs.

Intégrez les tests de performances dans les pipelines CI/CD (par exemple, Jenkins, GitLab, CircleCI) pour valider les performances sans ralentir les déploiements. Utilisez des disjoncteurs pour désactiver temporairement les points de terminaison problématiques et prévenir les défaillances en cascade. Enfin, connectez les améliorations techniques aux métriques commerciales—montrez comment une latence réduite augmente les taux de conversion ou la rétention des clients. Cela maintient les parties prenantes investies dans les mises à niveau de performances.

Pour les équipes créant de nouveaux front-ends sur des API optimisées, les constructeurs d'applications modernes peuvent accélérer considérablement le développement. La fonctionnalité Magic Add d'Adalo vous permet d'ajouter des écrans et des fonctionnalités en décrivant ce que vous voulez en langage naturel, tandis que X-Ray met en évidence les problèmes de performance avant qu'ils n'affectent les utilisateurs. Cette approche assistée par l'IA signifie que vous pouvez itérer rapidement au fur et à mesure que les performances de votre API s'améliorent, sans attendre les cycles de développement traditionnels.

Conclusion

La performance des API héritées est bien plus qu'une préoccupation technique—c'est une priorité commerciale critique. Comme Nordic APIs l'énonce judicieusement :

« La performance de l'API est tout. C'est la seule chose qui sépare le succès de votre API et vos utilisateurs abandonnant votre API en faveur de quelque chose de plus fiable et efficace. »

Quand les API sont lentes, les utilisateurs s'en vont. Même de légers délais peuvent entraîner des baisses nettes des taux de conversion, tandis que les développeurs perdent un temps précieux à chasser les bugs au lieu de créer de nouvelles fonctionnalités.

Le côté positif ? Vous n'avez pas besoin d'une refonte complète pour voir les résultats. Un mélange de gains rapides et d'améliorations stratégiques peut faire l'affaire. Commencez par des correctifs simples comme la mise en cache, qui peut réduire les temps de réponse de 70–90%, ou la compression, qui réduit la taille des charges utiles de 60–80%. Ces changements non seulement fournissent des améliorations immédiates, mais posent également les bases pour des initiatives plus importantes comme la transition vers les microservices.

Pensez à l'optimisation comme à un processus étape par étape, pas un effort unique. Commencez par mesurer vos performances actuelles, puis concentrez-vous sur les changements impactants au cours des 30 premiers jours. Traitez les goulots d'étranglement spécifiques au cours des trois prochains mois, et planifiez les mises à jour architecturales plus larges dans six mois ou plus. Cette méthode minimise les risques tout en assurant la stabilité du système tout au long de la transition.

Le coût de la négligence des performances va bien au-delà des API lentes. Les pertes de revenus dues à l'abandon des paniers, l'augmentation des dépenses d'infrastructure et les dommages à la réputation de votre marque constituent un argument convaincant pour une optimisation proactive. Les investissements dans l'amélioration des performances s'avèrent très rentables à long terme.

Pour rester en avance, rendez l'optimisation un effort continu. Intégrez les tests dans vos pipelines CI/CD et suivez les métriques comme les temps de réponse p95 et p99. Alignez les améliorations techniques sur les objectifs commerciaux clés comme l'augmentation des taux de conversion et la rétention des clients. Cette approche garantit que vos API non seulement répondent aux demandes de votre entreprise, mais stimulent également une croissance durable.

Articles de blog connexes

- 5 conseils pour réduire la latence des requêtes de base de données

- Comment les applications sans code se connectent aux systèmes hérités

- Améliorer le temps de réponse des API avec les bases de données héritées

- Intégration pilotée par les événements pour les systèmes hérités

FAQ

Pourquoi choisir Adalo plutôt que d'autres solutions de création d'applications ?

Adalo est un constructeur d'applications alimenté par l'IA qui crée de véritables applications iOS et Android natives à partir d'une base de code unique. Contrairement aux wrappers web, il compile vers du code natif et publie directement sur l'App Store d'Apple et le Google Play Store. À 36 $/mois sans limites sur les actions, les utilisateurs, les enregistrements ou le stockage, il offre une tarification prévisible sans les frais basés sur l'utilisation qui rendent les autres plateformes imprévisibles.

Quel est le moyen le plus rapide de créer et de publier une application sur l'App Store ?

Le générateur d'IA d'Adalo avec Magic Start crée des fondations d'application complètes à partir de descriptions textuelles—décrivez ce que vous voulez construire, et il crée automatiquement votre structure de base de données, vos écrans et vos flux utilisateur. La plateforme gère le processus complexe de soumission à l'App Store, de sorte que vous pouvez passer de l'idée à l'application publiée en jours plutôt qu'en mois.

Puis-je facilement construire des applications qui se connectent à des API héritées sans codage extensif ?

Oui. La fonctionnalité Collections externes d'Adalo vous permet d'extraire des données des microservices modernes et des bases de données héritées. Vous pouvez créer des applications prêtes pour la production qui interfacent avec les systèmes plus anciens tout en ajoutant des couches modernes de mise en cache et d'optimisation, le tout sans écrire de code.

Quelles sont les causes les plus courantes des performances lentes des API héritées ?

Les trois causes principales sont l'architecture obsolète (les systèmes monolithiques utilisant les anciens protocoles comme HTTP/1.1), la récupération de données inefficace (requêtes non indexées et problèmes N+1) et les systèmes de mise en cache manquants. Ces problèmes créent des goulots d'étranglement qui ralentissent les temps de réponse et frustrent les utilisateurs.

De combien la mise en cache peut-elle améliorer les temps de réponse de l'API ?

La mise en place de la mise en cache peut réduire les temps de réponse de l'API de 70% à 90% pour les réponses mises en cache. Une stratégie de mise en cache multi-niveaux utilisant la mise en cache de périphérie (Cloudflare), la mise en cache au niveau de l'application (Redis) et la mise en cache côté client offre les meilleurs résultats en abordant différentes parties du système.

Qu'est-ce que le motif Strangler Fig pour la modernisation des API ?

Le motif Strangler Fig est une approche de migration progressive où vous placez une passerelle API entre les clients et votre système hérité, puis remplacez lentement des fonctions spécifiques par des microservices. Cette méthode vous permet de moderniser progressivement tout en maintenant 100 % de disponibilité, réduisant ainsi le risque d'échecs de migration.

Quelles métriques dois-je surveiller pour les performances de l'API ?

Concentrez-vous sur les temps de réponse p95 et p99 (95e et 99e centiles) plutôt que sur les moyennes, car ceux-ci montrent comment les utilisateurs expérimentent votre API lors de trafic élevé ou de cas limites. Suivez également le Time to First Byte (TTFB), les taux d'erreur et les modèles de débit pour détecter les problèmes avant qu'ils n'impactent les utilisateurs.

Combien de temps faut-il pour moderniser un système d'API hérité ?

Une approche par phases fonctionne mieux : concentrez-vous sur des changements impactants comme la mise en cache au cours des 30 premiers jours, traitez les goulots d'étranglement spécifiques au cours des trois prochains mois, et planifiez les mises à jour architecturales plus larges dans six mois ou plus. Cela minimise les risques tout en assurant la stabilité du système tout au long de la transition.

Quelle est la différence entre le test de charge et le test de stress ?

Le test de charge simule le trafic normal à attendu au pic pour établir les repères de performance. Le test de stress pousse votre API au-delà de ses limites pour identifier les points de rupture et déterminer si votre système échoue gracieusement avec une limitation de débit ou s'il s'effondre complètement sous des conditions extrêmes.

Puis-je mettre à l'échelle les applications construites sur les plateformes modernes pour gérer des millions d'utilisateurs ?

Oui. L'infrastructure modulaire d'Adalo supporte les applications avec plus d'1 million d'utilisateurs actifs mensuels, traitant plus de 20 millions de demandes quotidiennes avec une disponibilité de 99 %+. Contrairement aux wrappers d'applications qui rencontrent des limitations de vitesse sous charge, cette architecture conçue à cet effet maintient les performances à l'échelle.

Créez votre application rapidement avec l'un de nos modèles d'application prédéfinis

Commencez à créer sans code